【

儀表網 研發快訊】過去幾十年間,計算機視覺研究取得了突破性進展。然而,深度神經網絡驅動的計算機視覺模型在功耗、存儲和響應時延等方面存在顯著的效率瓶頸,難以廣泛部署于機器人、移動設備或邊緣終端等資源受限的場景。此外,大型視覺模型巨大的訓練與推理開銷也使算力瓶頸問題和環境可持續性問題變得尤為突出。

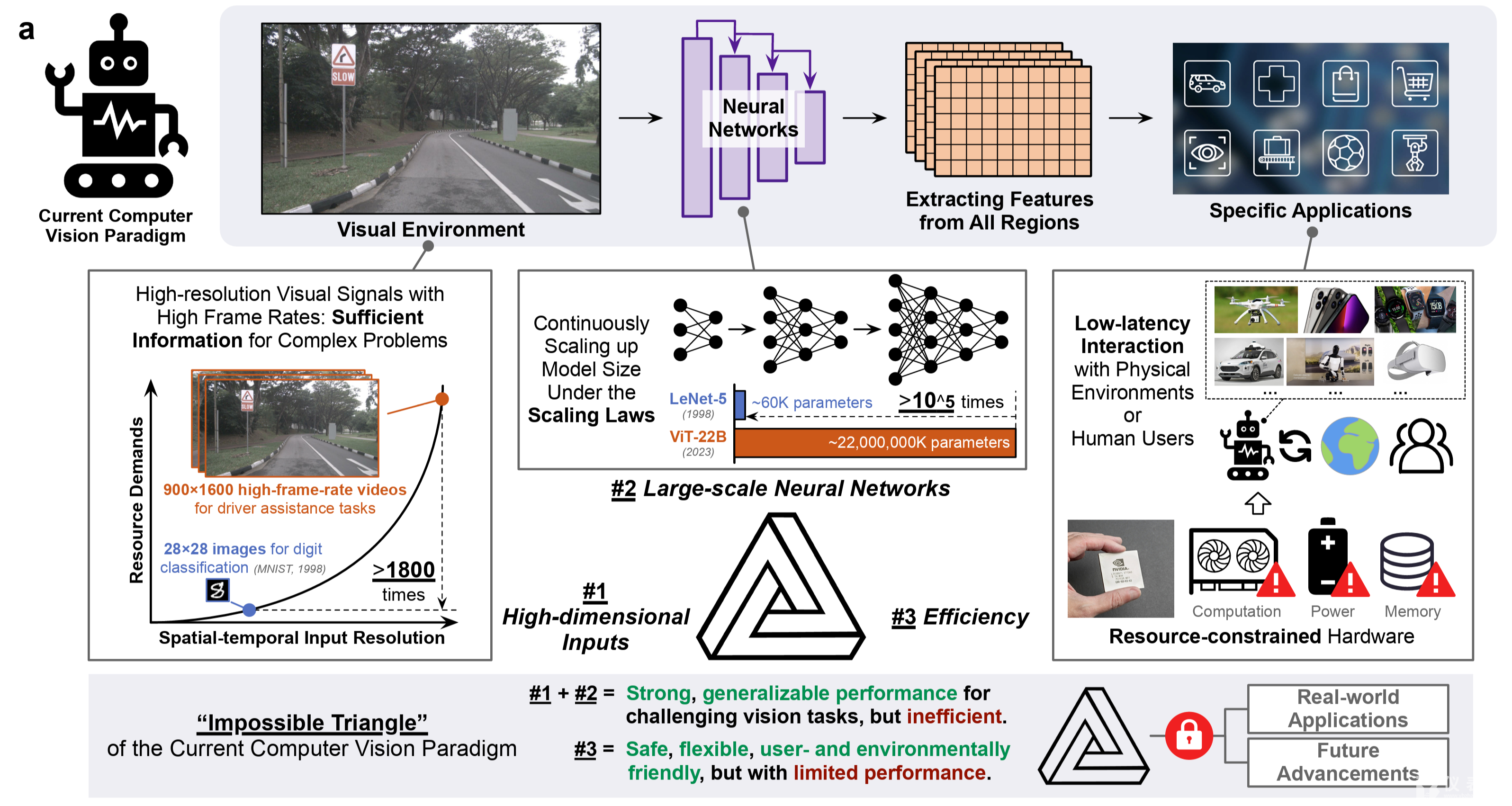

圖1.當前計算機視覺范式所面臨的能效瓶頸

人類

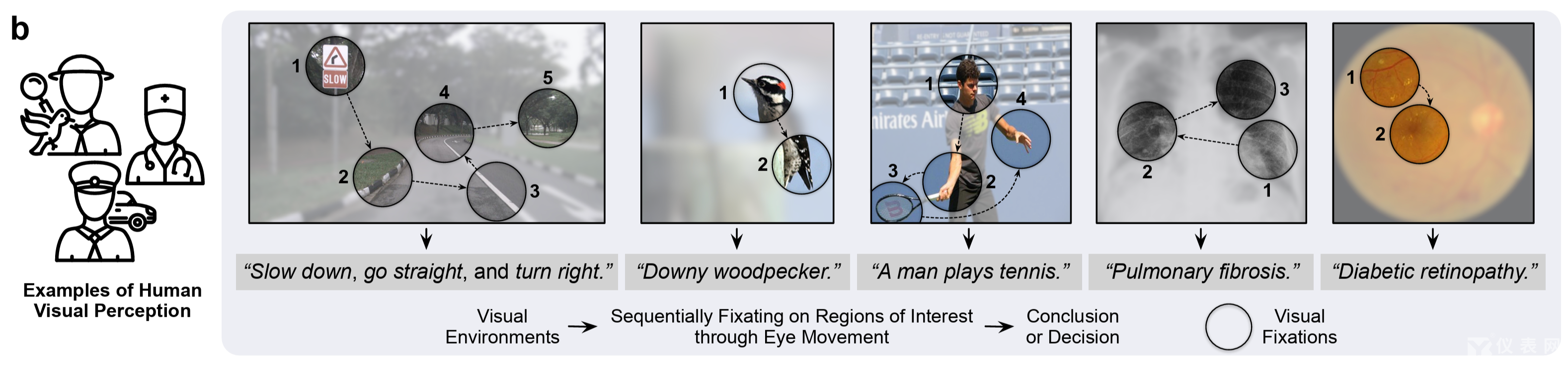

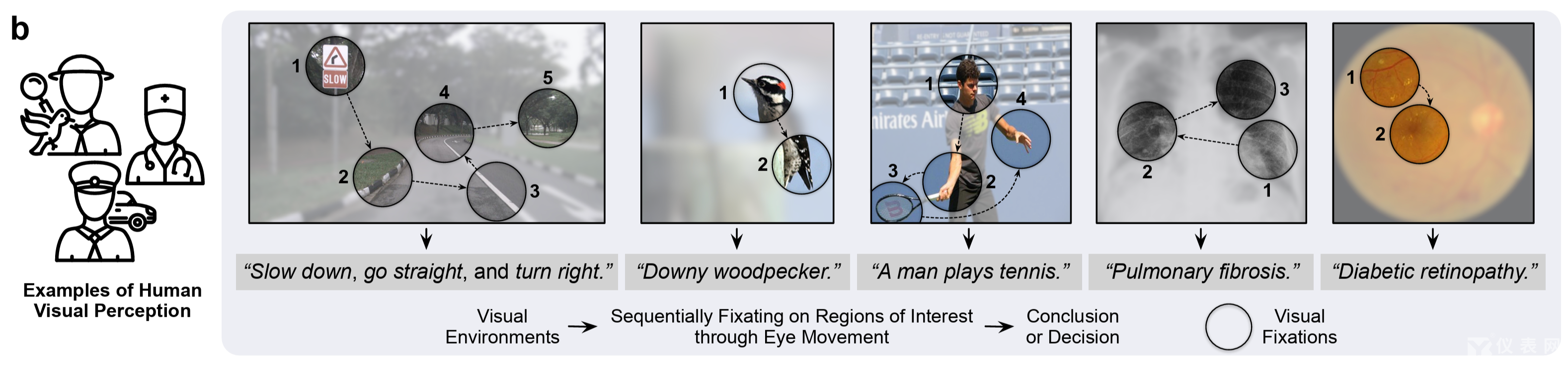

視覺系統能在龐雜的視覺輸入中快速篩取要點,大幅降低冗余計算,使得人類高度復雜的視覺系統能夠高效、快速運行。無論外界場景多么復雜,人類視覺系統的能耗主要取決于注視帶寬與注視次數,而非全局像素量。早在2015年,深度學習三位主要奠基人楊立昆(Yann LeCun)、本吉奧(Bengio)和辛頓(Hinton)便指出,未來的AI視覺系統應具備類人的、任務驅動的主動觀察能力。然而近十年以來,這一方向仍缺乏系統性研究。

圖2.人類視覺系統的主動自適應感知策略

11月6日,清華大學自動化系宋士吉教授、黃高副教授團隊在《自然·機器智能》(Nature Machine Intelligence)上以“模擬人類自適應視覺,實現高效靈活的機器視覺感知”(Emulating human-like adaptive vision for efficient and flexible machine visual perception)為題發表論文,提出AdaptiveNN架構,通過借鑒人類“主動自適應視覺”機制,逐步定位關鍵區域、累積多次注視信息,并在信息足夠完成任務時主動終止感知過程。

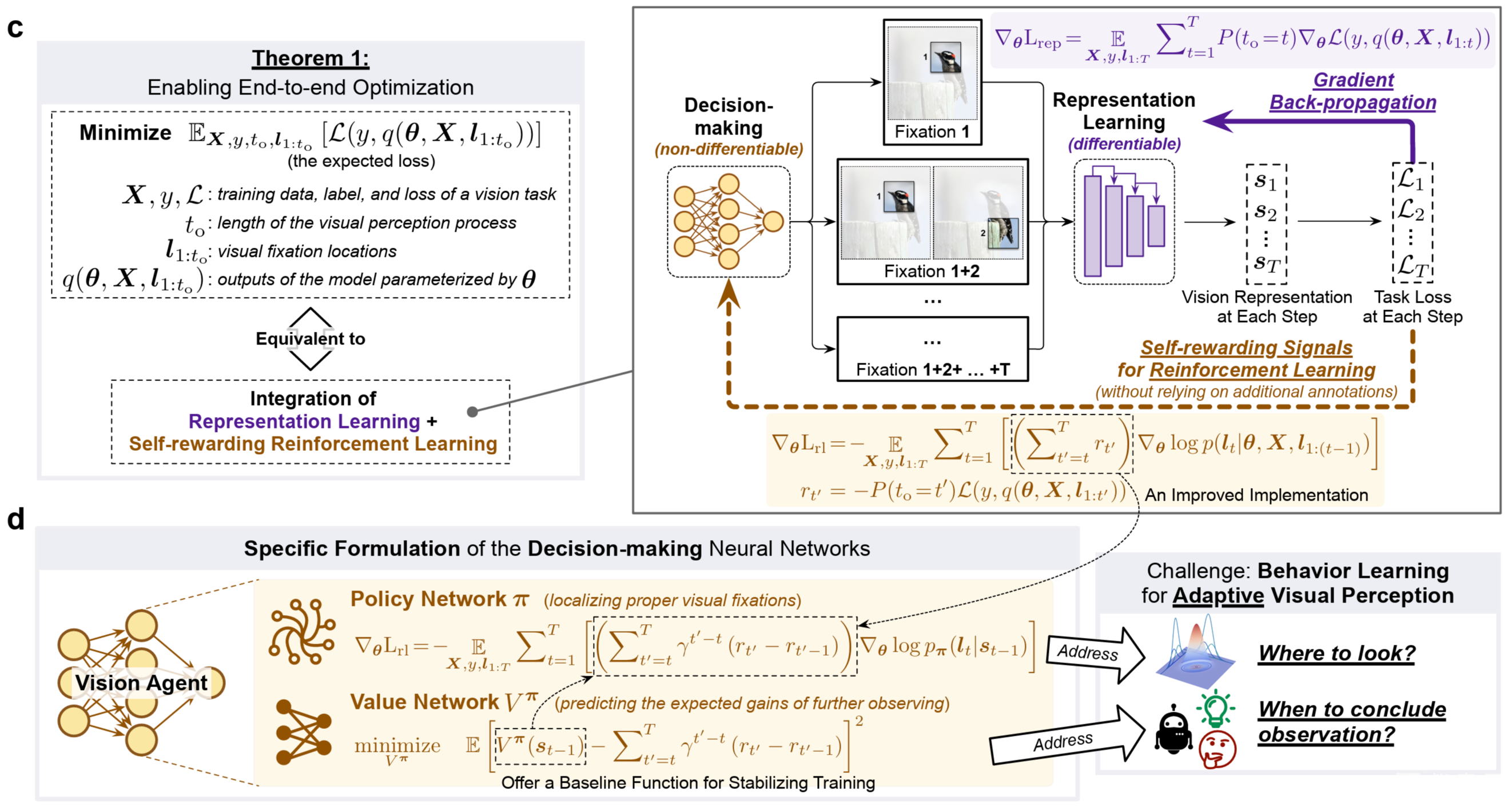

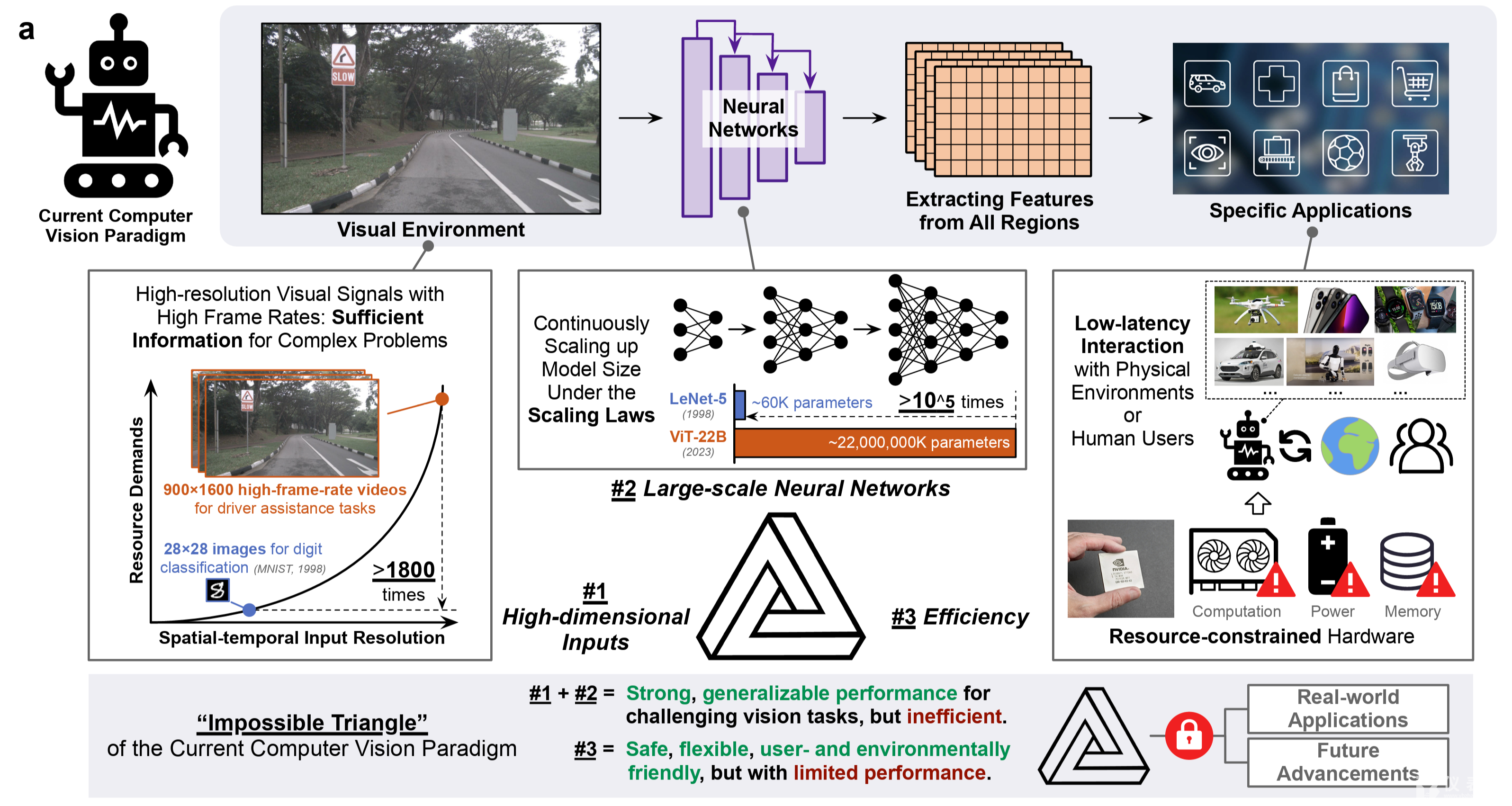

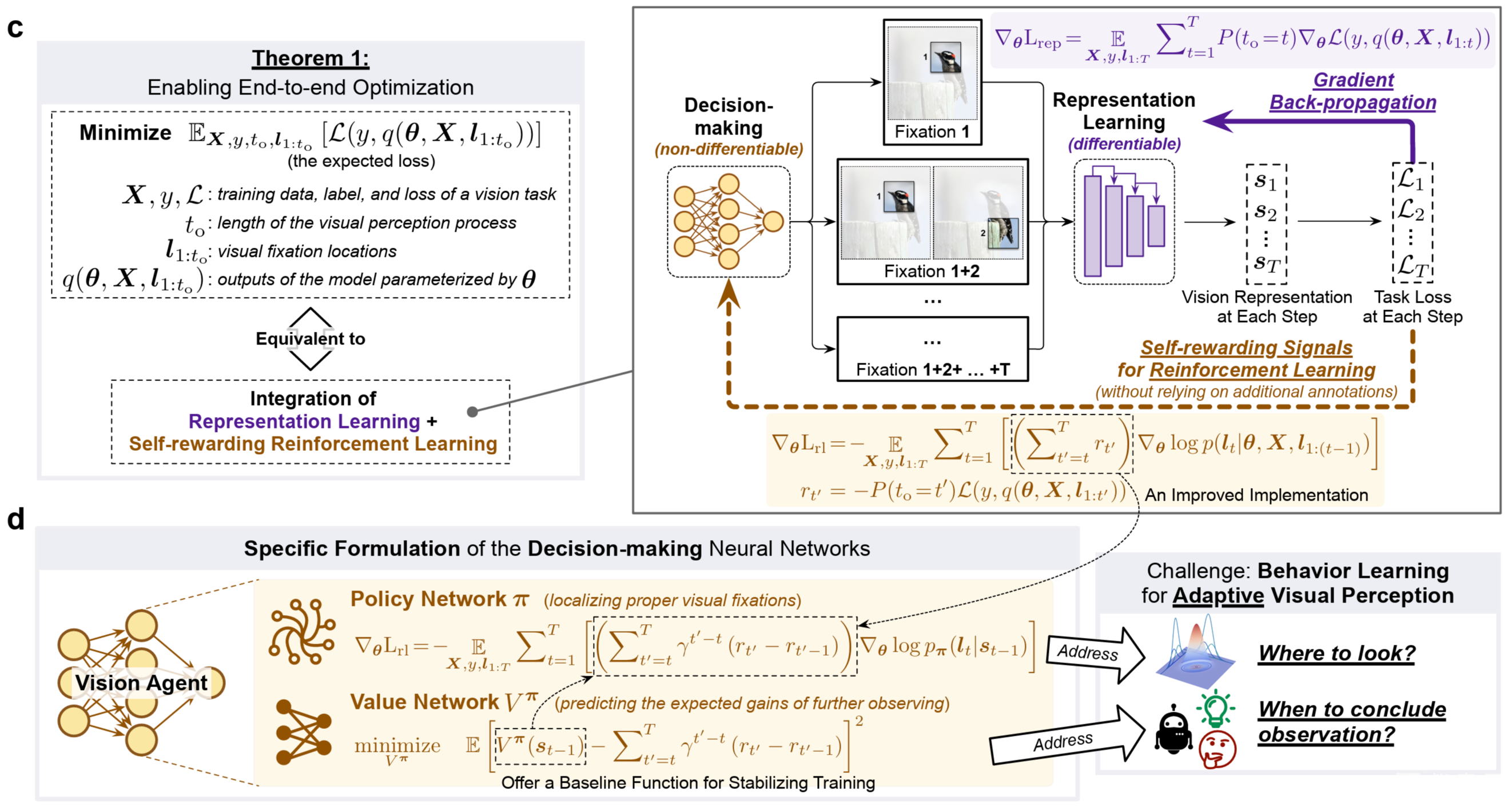

AdaptiveNN模型在一個視覺環境中,依次在若干感興趣區域上進行“注視”,逐步積累信息形成內部視覺表征,并動態決定何時結束該過程。在每一步,Vision Agent基于當前的內部視覺表征評估任務完成度,若信息不足,則通過策略網絡選擇下一次注視位置。每個選定的注視區域由表征提取網絡提取深度特征,從而不斷更新內部視覺表征用于后續決策。AdaptiveNN的整體框架模擬了人類從全局到局部、從粗到細的視覺感知策略,使神經網絡具備了類人式的主動感知能力,突破了傳統視覺模型的效率瓶頸。

AdaptiveNN在設計上具有較強的兼容性和靈活性,適用于多種不同的深度神經網絡基礎架構(如卷積網絡、Transformer等)和多種任務類型(如視覺識別、具身視覺感知、視覺-語言多模態聯合建模等)。

圖3.AdaptiveNN的網絡架構和推理過程

AdaptiveNN的訓練過程同時涉及連續變量(如從注視區域中提取特征)和離散變量(如決定下一次注視位置)的優化。具體而言,從期望優化目標出發,對整體損失函數進行分解,AdaptiveNN的端到端優化過程可自然地分解為兩項:第一項為表征學習目標(representation learning),對應于從注視區域中提取任務相關的特征;第二項為自激勵強化學習目標(self-rewarding reinforcement learning),對應于優化注視位置的分布,驅使模型的主動注視行為實現最大化的任務收益。這一理論結果揭示了AdaptiveNN的內在學習規律:主動感知的優化本質上是表征學習與強化學習的統一。

圖4.自激勵強化學習驅動的端到端主動視覺感知行為學習

研究團隊在九類典型視覺任務上對AdaptiveNN進行了實測驗證,AdaptiveNN展現出了高效、靈活和透明的特點。

圖5.ImageNet大規模視覺識別任務上的定性和定量實驗結果

研究團隊進一步將AdaptiveNN應用于具身智能的基礎模型——視覺語言動作模型(VLA)。結果表明,該框架在復雜操作場景中顯著提升了具身基礎模型的推理與感知效率,在保持任務成功率的同時將計算效率提升4.4至5.9倍。

圖6.ApdativeNN應用于VLA具身任務的實驗結果

綜上,AdaptiveNN提供了一種通用的高效視覺模型,對認知科學的研究具有啟發意義,有望用于模擬和檢驗人類的注意力分配、感知學習以及復雜任務中的視覺決策機制,為認知科學提供新的視角和工具。

清華大學自動化系2019級博士生王語霖,2022級博士生樂洋、樂陽為論文共同第一作者,自動化系教授宋士吉、副教授黃高為論文共同通訊作者。研究得到國家重點研發計劃青年科學家項目、國家自然科學基金重大儀器研制項目、聯合重點項目等的資助。

所有評論僅代表網友意見,與本站立場無關。